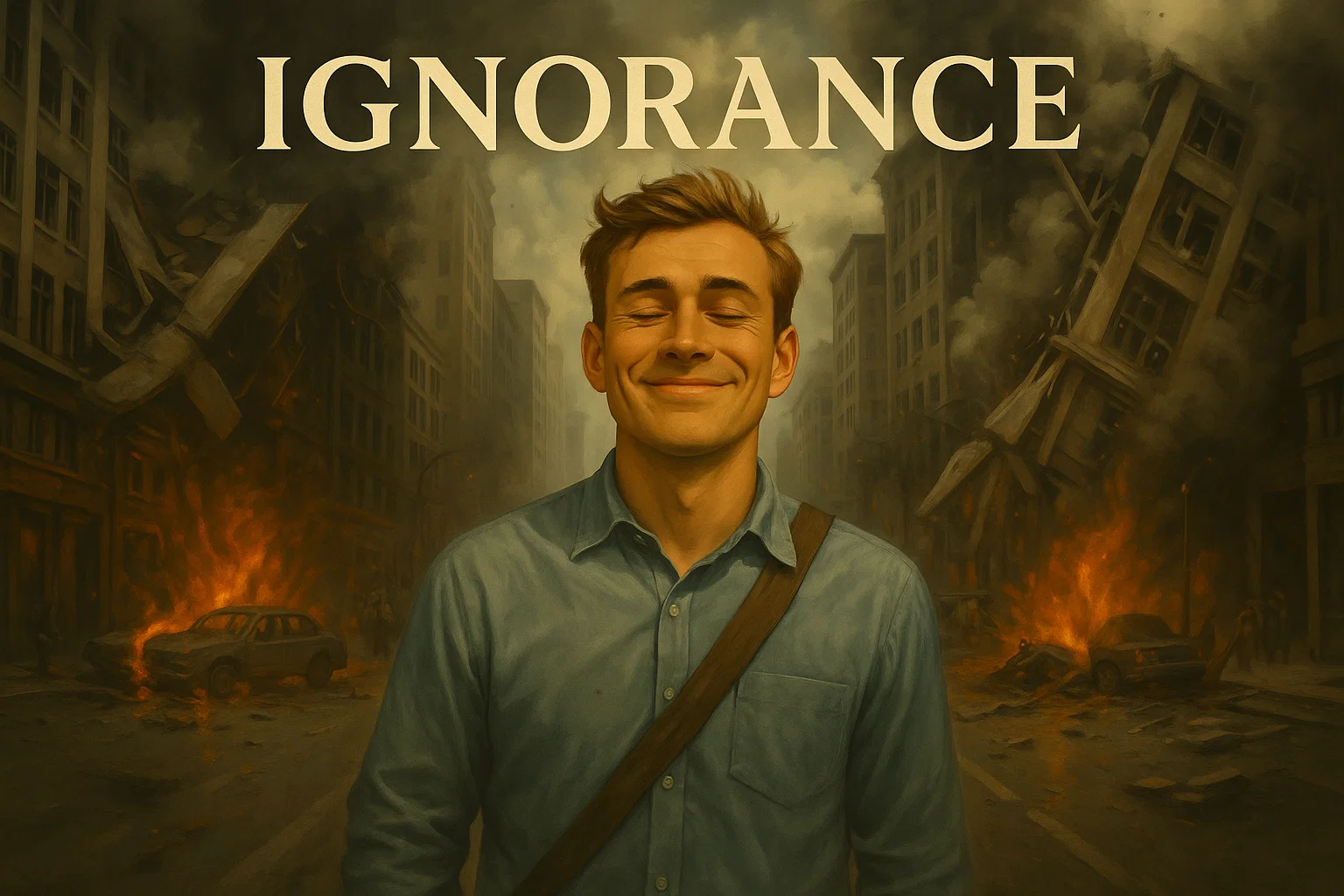

Et si le problème n’était pas l’irrationnel… mais l’excès de rationalité ? On croit souvent que les échecs sont causés par l’émotion, la panique, le manque de réflexion. Que le remède à tout, c’est plus de données, plus de logique, plus de rationalité. Mais il arrive que ce soit justement cette rationalité, poussée à l’extrême, qui devienne le poison. La guerre du Vietnam en est un exemple brutal. Derrière les défaites américaines, il n’y a pas seulement des erreurs militaires. Il y a une foi aveugle dans les chiffres. Une illusion de contrôle. Un piège cognitif qui porte un nom : le sophisme de McNamara.

La guerre des chiffres : quand la guerre devient un tableau Excel

Robert McNamara, ancien président de Ford et secrétaire à la Défense des États-Unis, croyait au pouvoir des données. Il pensait que tout pouvait être modélisé, mesuré, piloté. Même une guerre. Il arrive au Pentagone avec une approche d’ingénieur : réduire le chaos à une série d’indicateurs, puis optimiser.

Le Vietnam devient alors un projet rationnel. Nombre d’ennemis tués. Ratio pertes/coûts. Pourcentage de villages pacifiés. Kilomètres de route sécurisée. On mesure tout. Même les niveaux supposés d’intelligence des populations locales, via des tests indirects de QI et d’alphabétisation. L’idée est simple : anticiper leur comportement comme s’il s’agissait de consommateurs face à une marque dominante.

Mais dans ce flot de chiffres, une chose échappe aux modèles : la réalité humaine.

Le sophisme de McNamara : croire que ce qui ne se mesure pas n’existe pas

Le sophisme de McNamara désigne ce biais tragique : croire qu’on peut ignorer ce qu’on ne peut pas quantifier. Ce biais pousse à accorder une valeur excessive à ce qui est mesurable, et à négliger — voire mépriser — ce qui ne l’est pas.

Au Vietnam, cela a mené à des décisions absurdes : des villages pacifiés « sur le papier », pendant que la population fuyait ; des ennemis tués comptés comme indicateur de succès, sans se demander si cela réduisait vraiment la menace ; des victoires tactiques qui masquaient un désastre stratégique.

Mais ce biais ne s’arrête pas à la guerre. Il infecte nos institutions, nos entreprises, nos systèmes éducatifs.

Les biais cognitifs derrière le sophisme de McNamara

1. Le biais de simplification

Quand on ne peut pas tout comprendre, on réduit. On résume. On schématise. McNamara a ramené une guerre asymétrique, politique, culturelle et idéologique à une série de KPIs. Il a ignoré les émotions, la mémoire collective, l’attachement au territoire, la fierté, les humiliations. Ce qu’il ne pouvait pas modéliser, il l’a exclu.

Mais ce qu’on exclut finit toujours par nous exploser au visage.

2. L’illusion de contrôle

Le cerveau humain aime les chiffres parce qu’ils donnent l’impression qu’on maîtrise. Plus il y a de tableaux de bord, plus on croit piloter une situation. Pourtant, dans un système complexe, les données peuvent rassurer… tout en nous aveuglant.

Mesurer n’est pas comprendre.

3. La déshumanisation cognitive

En ramenant les Vietnamiens à des variables statistiques, McNamara a oublié qu’ils étaient des humains, pas des lignes dans un modèle. Il a supposé qu’ils réagiraient de manière rationnelle à la supériorité militaire américaine. Mais la rationalité n’est pas universelle. Elle est culturelle, subjective, émotionnelle.

Penser que les autres vont raisonner comme vous est une erreur stratégique majeure.

4. Le biais de surconfiance intellectuelle

McNamara, diplômé de Harvard, incarnait l’élite rationnelle. Il croyait qu’intelligence et méthode suffisaient. Mais son approche brillante a échoué parce qu’elle était trop fermée, trop sûre d’elle. Plus on pense être au-dessus du lot, moins on doute de ses modèles. Et plus on est aveugle face aux signaux faibles.

Pourquoi cette erreur continue de se reproduire

Le sophisme de McNamara ne s’est pas arrêté en 1975. Il est partout. Ce n’est pas la rationalité le problème. C’est sa version caricaturale, stérile, déconnectée du réel. Celle qui croit que tout ce qui compte se compte. Et qui oublie que l’humain — consommateur, citoyen, collaborateur — ne rentre jamais tout à fait dans un modèle.

Leçons pour aujourd’hui : apprendre à penser sans se couper du réel

1. Refuser la dictature des indicateurs

Un indicateur n’est pas un objectif. Ce n’est qu’un proxy, un reflet partiel. Le chiffre peut rassurer, mais il doit toujours être confronté à l’observation terrain, à l’écoute qualitative, au bon sens. Piloter uniquement par les chiffres, c’est naviguer dans le brouillard avec une carte incomplète.

2. Réhabiliter le jugement

Le jugement humain — quand il est nourri, lucide, critique — reste irremplaçable. Aucun algorithme ne peut saisir toutes les subtilités d’une situation humaine. Il faut donc réapprendre à faire confiance au discernement, à l’intuition informée, à l’expérience vécue.

3. Intégrer l’incertitude dans la décision

Ce qu’on ne comprend pas ou ne mesure pas n’est pas « hors-sujet ». C’est souvent là que se cache l’essentiel. Une bonne stratégie n’est pas celle qui prétend tout prévoir, mais celle qui accepte de naviguer dans l’incertain, qui reste souple, qui sait réagir.

4. Penser avec — et non contre — la complexité humaine

Une société, un marché, une guerre : ce sont d’abord des systèmes humains. Ils obéissent à des logiques émotionnelles, culturelles, symboliques. Les ignorer, c’est perdre.

Conclusion : penser mieux, ce n’est pas penser plus fort

McNamara était brillant. C’est ce qui rend son échec si éclairant. Il nous montre que l’intelligence n’est pas toujours un atout. Mal utilisée, elle devient un piège. Le cerveau humain aime les modèles, les données, les systèmes logiques. Mais ces outils doivent rester des aides — pas des oracles.

Le vrai défi n’est pas d’être plus rationnel. C’est d’être lucide : savoir quand la rationalité devient une illusion, un écran, une fuite.

Et surtout, ne jamais oublier que la chose la plus difficile à comprendre… c’est l’humain lui-même.

Pour aller au dela du sophisme de McNamara :

L’expérience de Milgram : pourquoi vous obéissez même quand vous ne voulez pas

Chambres d’écho : la cage dorée qui pense à votre place

Quand vos émotions prennent le pouvoir : le vrai coût invisible de votre libre arbitre

Laisser un commentaire